Ο Χρίστος Αλεξόπουλος σημειώνει ότι τα φονικά ρομπότ περνάνε στην πραγματικότητα. Η τεχνητή νοημοσύνη διευρύνει τα όρια της. Και τα ερωτήματα που προκύπτουν, καθημερινά πληθαίνουν.

Συνεχώς διευρύνονται τα όρια της αξιοποίησης της τεχνητής νοημοσύνης στους διάφορους τομείς δραστηριοποίησης των κοινωνιών. Από τους τομείς της παραγωγής και της υγείας επεκτείνονται με ταχύτατους ρυθμούς και καταγράφεται πολύ σημαντική παρουσία και στο στρατιωτικό πεδίο.

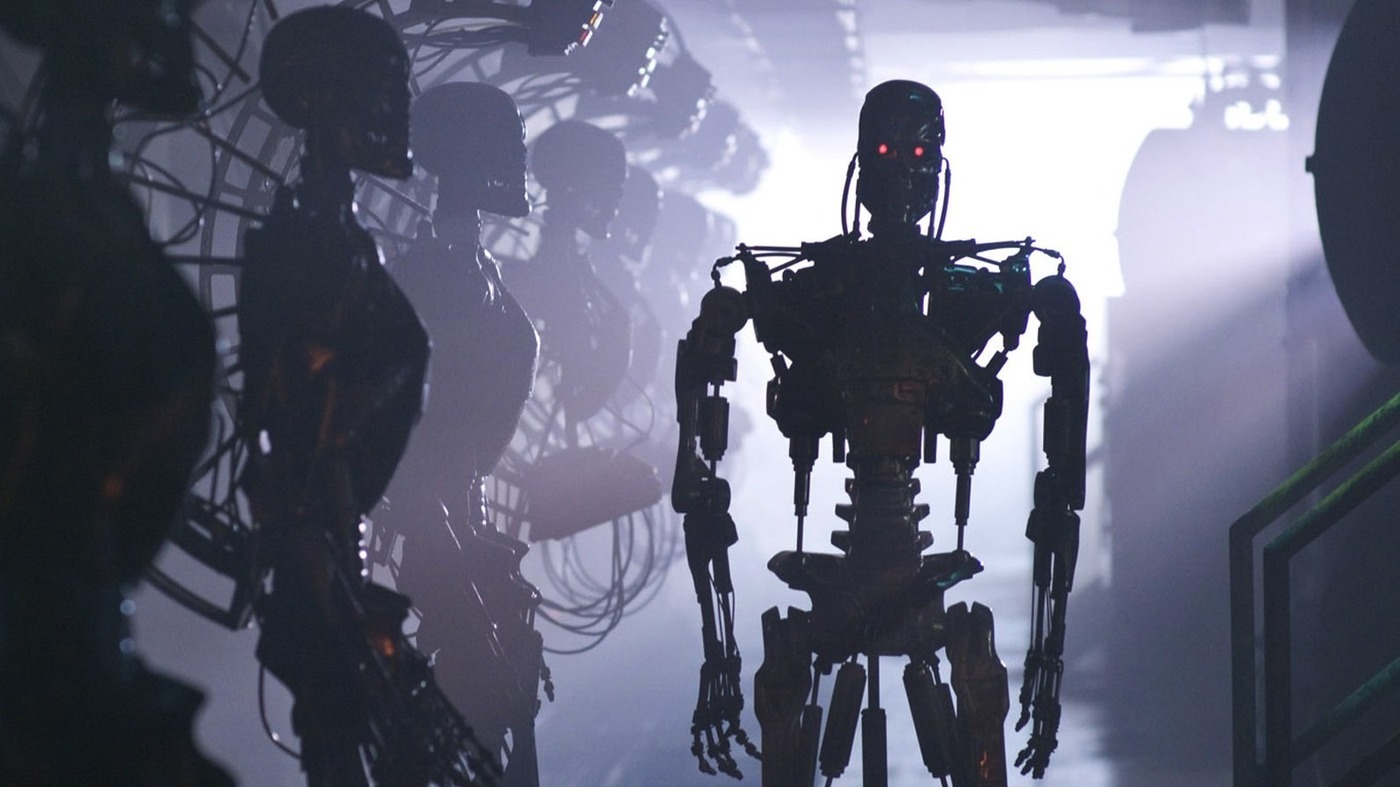

Από τα τηλεκατευθυνόμενα Drohnes, τα οποία πλέον χρησιμοποιούνται ευρέως και σε πολεμικές επιχειρήσεις, τα ισχυρά κράτη στον γεωπολιτικό και στον στρατιωτικό τομέα «περνάνε» στην πραγματικότητα των Killerroboter (ρομπότ δολοφόνοι).

Στις 11 Φεβρουαρίου 2019 ο πρόεδρος των Ηνωμένων Πολιτειών Αμερικής Donald Trump προέβη στην έκδοση Διατάγματος, το οποίο προωθεί τον ηγετικό ρόλο των ΗΠΑ και νομιμοποιεί την στρατηγική επιλογή της παραγωγής και χρήσης αυτόνομων όπλων.

Το επόμενο βήμα θα μπορούσε να είναι η υποκατάσταση του στρατιωτικού σχεδιασμού, ο οποίος βασίζεται στην αξιοποίηση της ανθρώπινης νόησης, από την τεχνητή νοημοσύνη στο πλαίσιο των αυτόνομων όπλων, δηλαδή οπλικών συστημάτων, τα οποία θα λαμβάνουν αποφάσεις και παράλληλα θα ενεργοποιούνται για την υλοποίηση τους χωρίς την παρεμβολή του ανθρώπινου παράγοντα.

Αυτή η προοπτική προκαλεί σειρά ερωτημάτων σε σχέση με την συνειδητοποίηση από την ανθρωπότητα της διακινδύνευσης, που συνεπάγονται τα αυτόνομα οπλικά συστήματα και τον ρόλο, τον οποίο θα διεκπεραιώνει ο άνθρωπος ως φορέας ευθύνης τόσο στο πολιτικό όσο και στο κοινωνικό επίπεδο.

Τελικά τα αυτόνομα οπλικά συστήματα θα αποφασίζουν για την ζωή ή τον θάνατο;

Ποιοί ηθικοί κανόνες μπορούν να διέπουν την λειτουργία της τεχνητής νοημοσύνης σε συνθήκες πολέμου;

Πως θα μπορούν τα αυτόνομα οπλικά συστήματα να διερευνούν την βούληση και τις προθέσεις του «αντιπάλου» όχι μόνο ως στρατιωτικής αλλά και ως κοινωνικής και πολιτικής οντότητας, ώστε να λαμβάνουν ρεαλιστικές και λειτουργικές αποφάσεις για την ειρηνική συμβίωση των λαών;

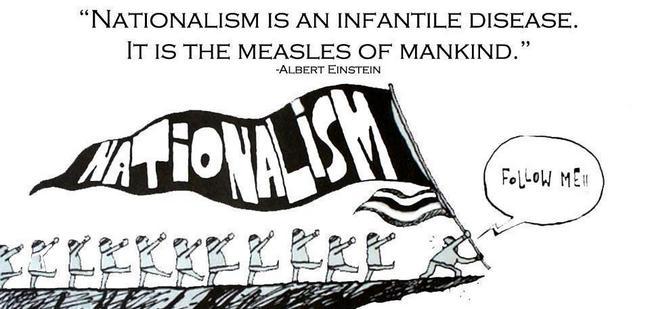

Τελικά η παγκόσμια κοινότητα συνειδητοποιεί την κατεύθυνση, που «παίρνει» η δυναμική της εξέλιξης με την αξιοποίηση της τεχνητής νοημοσύνης χωρίς ηθικές αξίες, οι οποίες διέπονται από τον ανθρωπισμό, αλλά λειτουργεί ως μέσο για την επιβολή σχέσεων κυριαρχίας και γεωπολιτικής ισχύος;

Από την μέχρι τώρα πορεία των διεργασιών και διαπραγματεύσεων στον Οργανισμό Ηνωμένων Εθνών για την θεσμοθέτηση και ενεργοποίηση κανόνων σε σχέση με την χρήση όπλων δεν διαφαίνεται θετική προοπτική για το μέλλον. Αρκετά κράτη δημιουργούν προσκόμματα και δεν επιτρέπουν με την στάση τους την επίτευξη συμφωνίας. Μεταξύ αυτών είναι οι Ηνωμένες Πολιτείες Αμερικής, η Ρωσία, η Αυστραλία, η Μεγάλη Βρετανία, η Νότια Κορέα και το Ισραήλ.

Θετική στάση τηρούν 28 κράτη κυρίως από την Αφρική και την Νότια Αμερική, τα οποία τάσσονται κατά της χρησιμοποίησης της τεχνητής νοημοσύνης σε οπλικά συστήματα. Από την Ευρωπαϊκή Ένωση μόνο η Αυστρία συμπορεύεται με αυτές τις χώρες.

Τα εμπειρικά δεδομένα από την πορεία της παγκόσμιας κοινότητας δείχνουν, ότι σταδιακά «μετατοπίζεται» η ευθύνη λήψης αποφάσεων για την διαχείριση πολεμικών επιχειρήσεων σε συνθήκες πολέμου από τον άνθρωπο στα αυτόνομα οπλικά συστήματα.

Τι γίνεται όμως σε περίπτωση λάθους; Οι εξελίξεις δεν είναι εύκολα προβλέψιμες σε περιπτώσεις πολεμικής αντιπαράθεσης, διότι οι συνθήκες, που διαμορφώνονται, επηρεάζονται από πολλούς παράγοντες, οι οποίοι δρομολογούν μεγάλη ρευστότητα, όπως είναι για παράδειγμα η ξαφνική εμπλοκή περισσοτέρων δυνάμεων, με αποτέλεσμα την ανατροπή των δεδομένων.

Σε αυτή την περίπτωση είναι απαραίτητη η παρέμβαση του ανθρώπινου παράγοντα, ώστε να συνεκτιμηθούν οι συνθήκες, που διαμορφώνονται ευρύτερα και η προοπτική του μέλλοντος.

Γι’ αυτό η ευθύνη πρέπει να παραμένει πάντα στην ανθρώπινη οντότητα, ανεξάρτητα από το εάν την αναλαμβάνει ή όχι ή γίνονται λανθασμένες επιλογές. Είναι δε πολιτική και κοινωνική, είτε συνειδητοποιείται είτε όχι.

Το πολιτικό σύστημα δεν μπορεί να αποποιηθεί της ευθύνης του, διότι αυτό αποφασίζει για την χρησιμοποίηση της τεχνητής νοημοσύνης στην κατασκευή και χρήση αυτόνομων οπλικών συστημάτων, τα οποία υποκαθιστούν την ανθρώπινη νόηση και ευθύνη με την τεχνητή νοημοσύνη και τα Killerroboter.

Η αξία της ανθρώπινης ζωής ουσιαστικά καταργείται και αποκτά χαρακτηριστικά και ρόλο εργαλείου, ενώ ο πόλεμος μετατρέπεται σε ρυθμιστικό παράγοντα της ιστορικής διαδρομής του ανθρώπου, ο οποίος όμως δεν έχει βούληση και το ανάλογο πολιτικό βάρος ως πολίτης σε δημοκρατικές κοινωνίες, διότι αποφασίζει η τεχνητή νοημοσύνη.

Με αυτό τον τρόπο, βέβαια, δεν εκφράζεται ούτε πραγματώνεται το κοινωνικό συμφέρον από το πολιτικό σύστημα, που διαχειρίζεται την κυβερνητική εξουσία. Ακόμη περισσότερο δεν διασφαλίζεται η ζωή και η ευημερία των ανθρώπων, ούτε αντιμετωπίζονται τα γενεσιουργά αίτια, τα οποία οδηγούν σε πολεμικές αντιπαραθέσεις.

Παράλληλα δεν ενημερώνονται από το πολιτικό σύστημα οι πολίτες τόσο ως άτομα όσο και ως συλλογικό μόρφωμα για τις πραγματικές επιπτώσεις της χρήσης των αυτόνομων οπλικών συστημάτων και για το τεράστιο ηθικό κενό, που συνεπάγεται η χρησιμοποίηση τους.

Η κοινωνική ευθύνη δεν αναλαμβάνεται, διότι οι πολίτες δεν είναι ενημερωμένοι, ενώ παράλληλα οι κοινωνικές αξίες δεν διέπονται από ηθικούς κανόνες, οι οποίοι είναι αποτέλεσμα διαλόγου και κοινωνικής αποδοχής, αλλά υπηρετούν την λειτουργικότητα του ισχύοντος μοντέλου κοινωνικής και οικονομικής δραστηριοποίησης και την οικονομική του απόδοση, χωρίς πλαίσιο κοινωνικής δικαιοσύνης και βιωσιμότητας του ανθρώπου και του φυσικού περιβάλλοντος.

Είναι τραγικό για την ανθρώπινη ιστορική διαδρομή, οι κοινωνίες με την δραστηριότητα, που αναπτύσσουν, να προκαλούν πλανητικής εμβέλειας προβλήματα, όπως είναι η κλιματική αλλαγή και οι μαζικές μετακινήσεις πληθυσμών και οι πολιτικές τους ηγεσίες λόγω σκοπιμοτήτων και οικονομικών συμφερόντων και οι πολίτες λόγω άγνοιας να προωθούν την παραγωγή και χρήση αυτόνομων οπλικών συστημάτων, τα οποία θα αποφασίζουν με σημείο αναφοράς αλγορίθμους για την ζωή των ανθρώπων.

Πραγματικά αναρωτιέται ο κάθε καλοπροαίρετος και νοήμων πολίτης, εάν η παρακμή αυτής της εμβέλειας και τόσο μεγάλου βάθους είναι δυνατόν να ανατραπεί και να διαμορφωθούν οι προϋποθέσεις για μια βιώσιμη πορεία με λειτουργική αξιοποίηση της τεχνητής νοημοσύνης για την ανθρώπινη ζωή και την ευημερία των κοινωνιών.

Η απάντηση είναι δύσκολη. Οι συνθήκες, που επικρατούν τόσο στο πολιτικό όσο και στο κοινωνικό επίπεδο, είναι αρνητικές, διότι έχουν συσσωρευθεί πολλά πλανητικής εμβέλειας προβλήματα με παράλληλη κατάρρευση του συστήματος κοινωνικών αξιών με σημείο αναφοράς την ηθική του ανθρωπισμού.

Δεν υπάρχει όμως άλλη επιλογή εκτός από την προσπάθεια για την ανατροπή των αρνητικών δεδομένων, που δημιούργησε η μέχρι τώρα ιστορική διαδρομή του ανθρώπου. Πρέπει όμως οι κοινωνίες με τις δομές, που διαθέτουν, να ενεργοποιηθούν και να ασκούν λειυουργικό έλεγχο με στόχο την πραγμάτωση του κοινωνικού συμφέροντος και της ειρήνης.